OK Go sort un clip musical entièrement réalisé avec Blender

- Mis à jour le : 20 septembre, 2025

Un clip musical… made in Blender

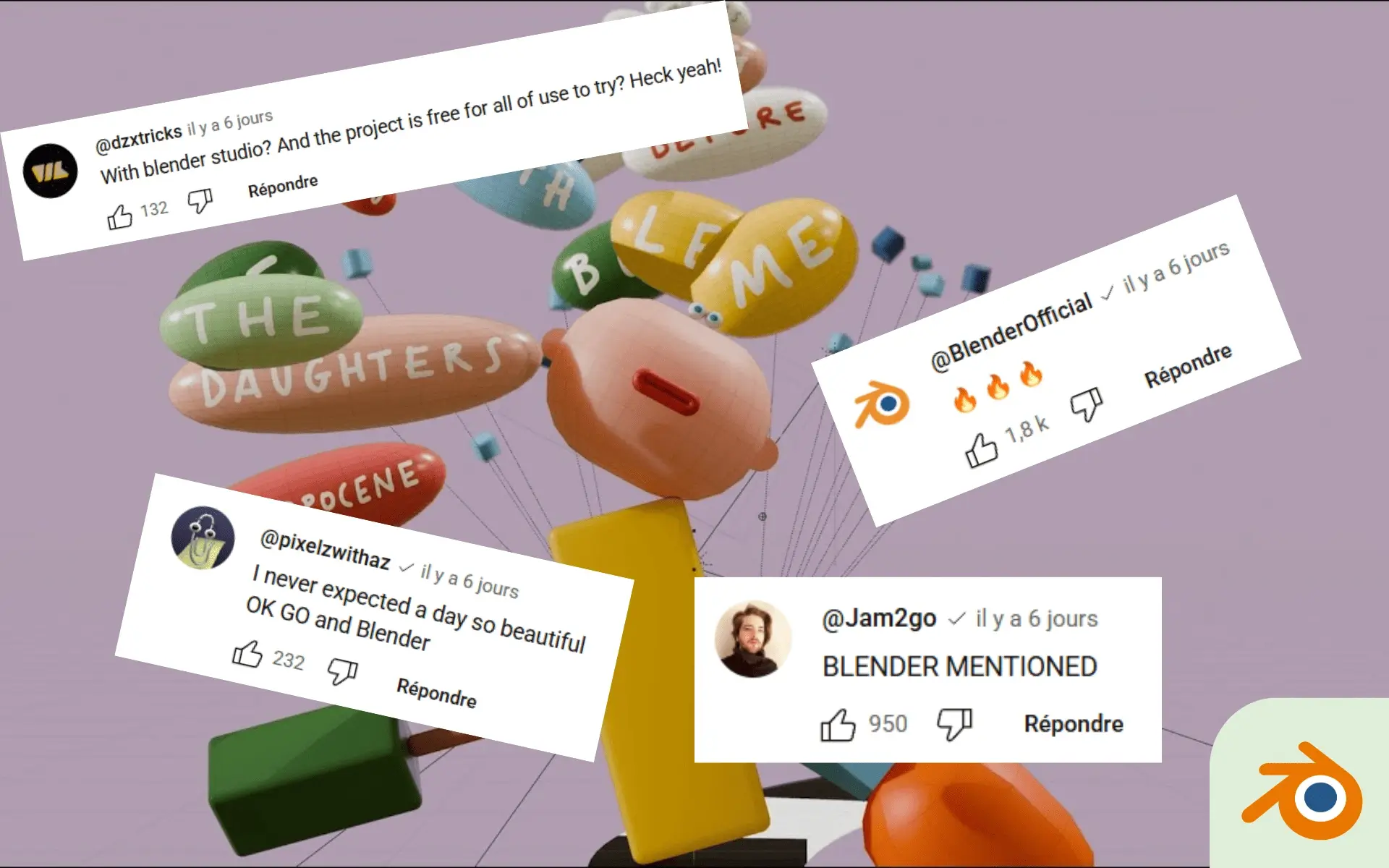

Un nouveau clip musical vient de sortir : Impulse Purchase. Alors, pourquoi parler de musique ici ? Parce que le dernier titre du groupe OK Go a été réalisé de A à Z dans Blender. Oui, vous avez bien lu : pas un logiciel de montage classique, pas un logiciel payant, mais notre bon vieux Blender.

Ça mérite qu’on y jette un œil, n’est-ce pas ? Parce que, soyons honnêtes, voir un groupe de musique reconnu utiliser Blender pour produire un clip, ça change un peu des tutoriels d’éclairage ou de modélisation de donuts. (Rien contre les donuts, promis.)

Dans cet article, on va explorer le rôle de Blender dans le projet, l’importance de la capture faciale pour l’animation, et les outils techniques qui ont été mis en œuvre. Et pour finir, la cerise sur le gâteau : tous les fichiers sont librement accessibles, histoire que vous puissiez tester l’animation depuis votre ordi.

Sommaire

Quand Blender devient la star d’un clip musical

Vous ne connaissez peut-être pas leur nom, mais OK Go est un groupe américain qui s’est fait connaître grâce à ses clips musicaux originaux et souvent un peu déjantés. L’un d’eux, celui avec les tapis roulants, a même fait le tour d’internet. Cette fois, ils reviennent avec Impulse Purchase, un clip créé entièrement dans Blender.

Pour ce projet, OK Go a collaboré avec deux réalisateurs : Will Anderson, déjà récompensé par un BAFTA, et Lucas Zanotto, un designer reconnu pour son style graphique minimaliste et coloré. Ensemble, ils ont construit ce projet avec le Blender Studio, l’équipe officielle derrière de nombreux courts-métrages open source.

À l’origine, l’idée était assez simple : réaliser une vidéo avec des paroles animées. Mais le projet a vite pris une autre direction. L’équipe a décidé de transformer le clip en une animation générative, capable de réagir en direct, et de pousser Blender bien plus loin qu’un simple rendu final.

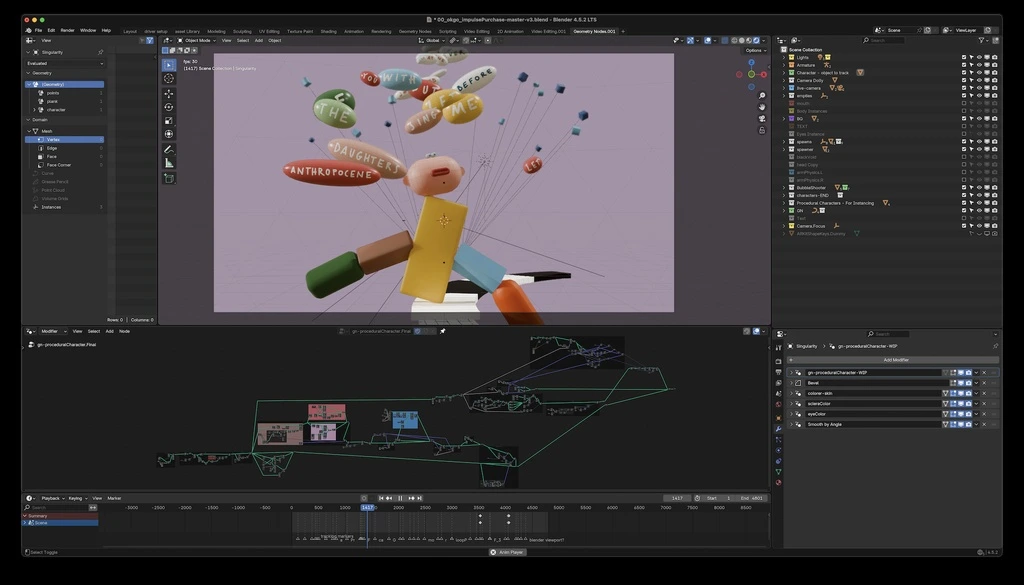

Concrètement, tout se passe dans un unique fichier Blender (.blend). Le décor, le personnage, l’animation, les effets procéduraux… tout est contenu dans ce fichier. Pas de montage externe ni d’outils supplémentaires : le clip entier existe dans Blender.

Le modèle 3D principal animé par capture faciale

L’une des grandes originalités d’Impulse Purchase, c’est la manière dont le personnage principal prend vie. Ici, pas de keyframes posés image par image comme dans une animation classique. Le visage du personnage est piloté en temps réel grâce à la capture faciale.

Comment ça marche ? Les mouvements du visage d’un interprète sont enregistrés avec une application de face capture (par exemple Live Link Face, disponible sur iOS et Android). Ces données sont ensuite envoyées directement dans Blender via le protocole OSC (Open Sound Control). Résultat : quand la personne sourit, fronce les sourcils ou parle, le personnage dans Blender fait exactement la même chose, en direct.

Et comme si ce n’était pas assez, ce système est totalement reproductible chez vous. L’équipe du Blender Studio a même publié un article complet sur le sujet : Blender OSC Live Puppeteering Demo. Vous y trouverez aussi l’add-on Foscap, qui facilite la connexion entre l’app de capture et Blender. De quoi tester la technologie sur votre propre ordinateur, avec un simple smartphone.

Les fonctionnalités de Blender derrière le projet

Derrière ce clip, il n’y a pas seulement une idée originale : il y a surtout un usage malin de plusieurs outils de Blender, combinés de manière cohérente. Voici les trois principaux :

- Geometry Nodes : ils permettent de créer des animations procédurales, c’est-à-dire des formes ou des mouvements générés automatiquement à partir de règles. Dans Impulse Purchase, ils servent à donner vie à certains éléments graphiques qui réagissent de façon dynamique, sans qu’il soit nécessaire d’animer chaque détail à la main.

- L’OSC (Open Sound Control) : ce protocole relie le visage de l’interprète à Blender. C’est grâce à lui que le face tracking fonctionne : les expressions captées en direct — un sourire, un froncement de sourcils, un mouvement de bouche — sont transmises instantanément au personnage virtuel.

- Keyframes : toujours utiles, ils ne disparaissent pas pour autant. Ils sont utilisés pour les actions qui doivent rester stables et identiques à chaque lecture, comme des transitions ou des mouvements de caméra précis.

Ce mélange entre procédural, face tracking en temps réel et animation traditionnelle résume bien la force de Blender aujourd’hui : un seul projet peut réunir plusieurs approches d’animation.

Tous les fichiers disponibles en téléchargement

Ce projet n’aurait pas la même saveur sans la touche open source. Fidèle à son ADN, le Blender Studio n’a pas seulement participé à la création du clip : il a aussi décidé de tout partager.

Et quand je dis tout, c’est vraiment tout : le fichier Blender (.blend) complet du projet, la documentation, les réglages techniques, et même une version simplifiée pour ceux qui veulent expérimenter sans se perdre dans un labyrinthe de nodes.

L’ensemble est disponible sur le site officiel du Blender Studio. Petite précision toutefois : le fichier Blender complet (avec la scène entière, les assets et tous les réglages) est réservé aux abonnés. En revanche, la documentation et une version simplifiée restent accessibles à tous.

En résumé : non seulement vous pouvez regarder le clip, mais vous pouvez aussi mettre les mains dedans. De quoi apprendre, tester, et peut-être trouver l’inspiration pour vos futures créations.

Un guide PDF gratuit de mes 10 conseils et astuces pour bien débuter avec le logiciel Blender, ça vous dit ?

À propos de l’auteur

Diplômé d’un master en informatique, j’ai adopté Blender comme mon terrain de jeu favori depuis 4 ans. Quand je ne suis pas en train d’explorer Blender ou de regretter mes années Xbox, je tente d’apprendre l’italien à Turin. Et, spoiler : la 3D, c’est plus facile !